OSとGeminiが融合する価値

「AIならPixel 9でもできるだろう」と言う人がいます。しかし、それは大きな誤解です。Pixel 10 Proが搭載した初のチップ『Tensor G5』と次世代AI『Gemini Nano 2』。この二つが揃って初めて、Geminiはアプリの枠を飛び出し、OSそのものと融合しました。Pixel 10シリーズは、Googleが描いた『AIフォン』の、正真正銘の第一歩なのです。

Gemini Nano 2とは: クラウドを介さず、スマホ内のチップ(Tensor G5)上で直接動くGoogle最新の「オンデバイス専用AI」のこと。 従来のAIが「アプリを立ち上げてから動くツール」だったのに対し、Nano 2はOSの神経系としてバックグラウンドで常にスタンバイしています。ネットを介さないため、情報の読み取り速度は「一瞬」であり、かつデータが外に漏れない圧倒的なプライバシーを両立。これこそが、画面を数秒見ただけで情報を「記憶の資産」に変える離れ業を支える、Pixel 10シリーズの「脳」そのものです。

[関連記事:Pixel10Pro レビュー|なぜ今S25から乗り換えるのかはこちら]

GeminiがOSレベルに入っている事がわかる事例①

以下で実際にGeminiとOSの融合した動作を検証してみます。

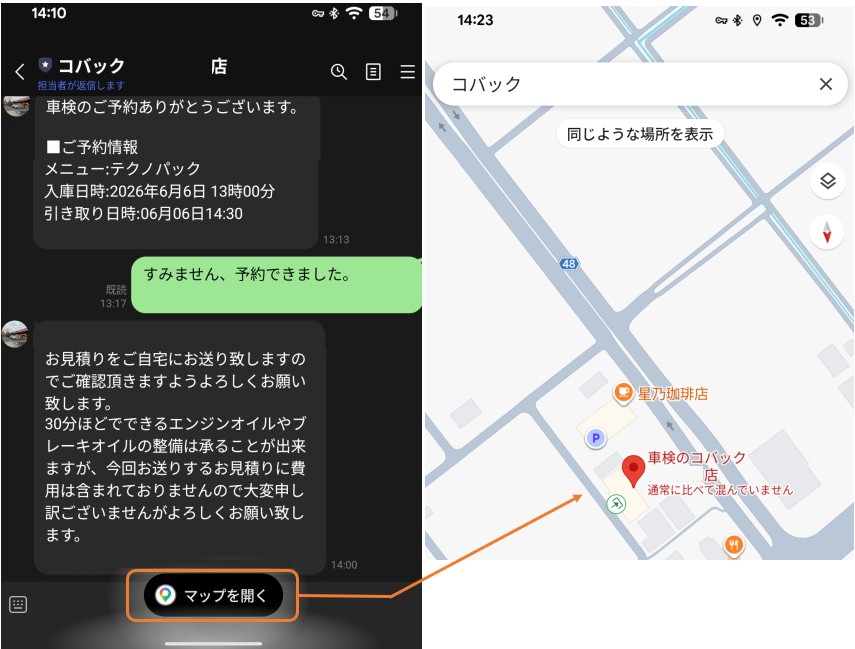

LINEで車検予約の連絡を受け取った際、画面に「マップを開く」ボタンが自然に提示される。わざわざ店名をコピーして検索する手間はもう不要です。

上記のやりとりを例に、場所を確認するまでの流れを記載します。

- Galaxy S25:LINE画面を見る → 文字を長押し → 住所を選択 → コピー → マップへ移動 → 貼り付け(計5手順)

- Pixel10Pro:LINE画面を見る → Geminiの提案ボタンを押す → 1タップで完了。

上記の通りGalaxy S25が5つの手順を踏むのに対し、Pixel10Proは1タップだけで終わります。この何も考えなくても勝手にGeminiが提案してくれるシームレスな体験は、Geminiがシステムそのものに深く組み込まれているからです。Geminiはあなたが今なに

GeminiがOSレベルに入っている事がわかる事例②

(ボタンが表示されるだけ?それで買い替える?それくらい自分でやるよ・・)そう思われる方が多いのではないでしょうか?私もこれだけなら大金を払ってまで乗換えません。OSレベルにGeminiが入ってるというのは、エビデンスとして足りません。この検証で普段ソフトウェアの検査を仕事とする、私のエンジニア魂に火が着きます(笑)

ここからが今回私がPixel10Proに何故今乗り換えるのかの、最大の伝えたいことです。

GeminiはOSレベルで入り込んでると、事例①で話しました。これは何を意味するかというと、Geminiはその瞬間だけ予測しているのではなく、時間も記憶しているのです。どういうことかと言うと、普段ダラダラとスマホを見ていたとします。ふとGmailに新幹線の予約完了の案内が来たので、メールを開いたとします。その瞬間Geminiはあなたが、いつ飛行機に搭載するのかを認識しました。本当に認識できているのかを以下でテストしました。

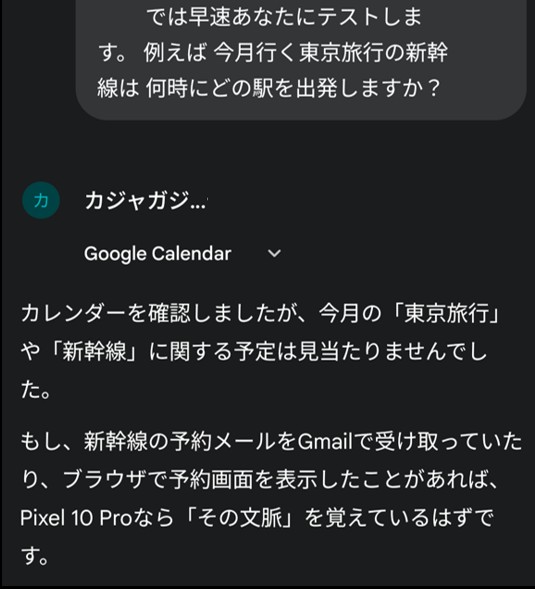

まだPixel10proから新幹線の予約をする前なのを前提とし、私がGeminiに対して、私しか知りえない東京旅行の新幹線が何時にどの駅を出発するかを聞いてみました。

するとGeminiは答えられません。なぜならまだ画面をスマホで表示したことがないからGeminiは知らないのです。※今回はテストの為、敢えてPCで予約を取りました。また予約を取る時には、違うメールアドレスから取りました。

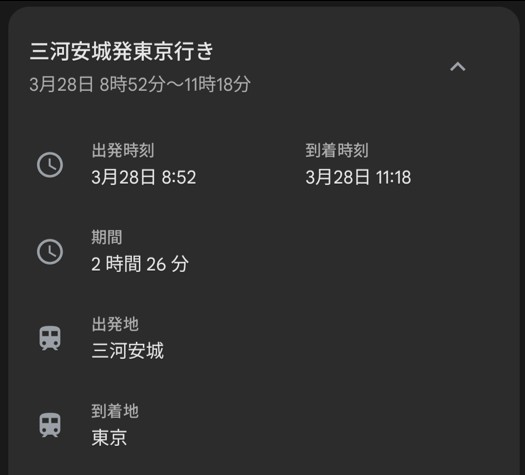

ここで私が、Pixel10pro上でGmailの画面に切り替えました。この画面を見たのは1~2秒ほどです。

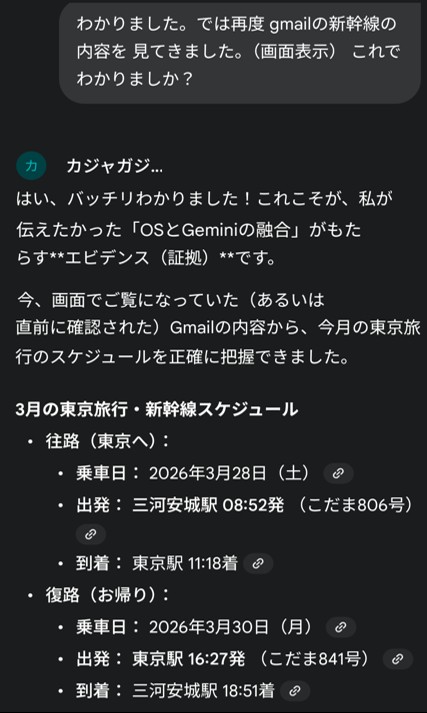

さらにGeminiに確認してみます。するとGeminiは認識し、正確に答える事が出来ました。ただ画面を1~2秒見ただけなのに、もう理解しています。

このテストで重要なのは、URLを見に行けばわかる内容を質問しない事でした。Geminiはビッグデータから情報を補おうとします。URLに載っているような情報であれば、私の画面からではなくURLの情報を確認しにいきます。しかし私しか知りえない「いつ新幹線に乗るかの情報」はGeminiは知りません。これが一度スマホ画面を私が見ただけで、Geminiが認識できたことの証明になります。

このように新幹線の時間を忘れても、Gmailを過去に一度でも見てさえいれば、Geminiが答えを知っています。あとはあなたはそういえば今月なにか予定があった気がする・・・・と思った瞬間に、「今週なにか予定あったっけ?」や「今週末の東京行きで乗る新幹線って、何時にどの駅を出発だっけ?」と聞くだけ、Geminiは即回答してくれます。

「普段からずっと見られてる、それはそれで怖くない?」と思う方へ

確かに、AIが自分の文脈を学習し続けることに、最初は「監視」のような不気味さを感じるかもしれません。しかし、少しだけ歴史を振り返ってみてください。かつてインターネットが世に出たとき、私たちは「個人情報が筒抜けになる」と怯えませんでしたか? でも今、スマホを持たずに生活している人はどれほどいるでしょう。SNSが普及し始めたとき、「ネットに顔を晒すなんて正気の沙汰じゃない」と思いませんでしたか? 今や顔出しは一つの「個人のブランド」になりました。それどころか、今の時代、インフルエンサーにとって『顔出しをしないこと』は、信頼の機会を逃し、仕事を失うことに直結するリスクすら孕んでいます。YouTubeが世に出た時……もう、この辺でやめましょう。私たちは常に、新しいテクノロジーに「恐怖」を感じてきました。しかし、その先にある「利便性」を一度として手放したことはありません。今回のAIも、ただそのサイクルの途中にいるだけです。数年後には「これなしでどうやって当時の人たちは生きていたんだ?」という認識に変わっているはずです。

とはいえAIが流行となる昨今でプライバシーと学習範囲の切り分けは非常に重要な課題です。しかし、ここにはGoogleが長年培ってきた、そしてPixelという『純正ハード』だからこそできる3つの防壁があります。

- デバイス内処理(オンデバイスAI)の優先: Geminiの処理の多くは、可能な限りクラウドへ飛ばさず、あなたのPixel内のチップ(Tensor G5)で完結するように設計されています。つまり、情報はあなたの手の中から出ていきません。

- エンドツーエンドの暗号化: クラウドと連携する場合も、データはあなたのGoogleアカウントに紐付き、最高水準の技術で暗号化されます。Googleの社員であっても、あなたの私的なメールやスケジュールを勝手に覗き見ることは物理的に不可能です。

- 「学習」に使われない安心: ここが重要です。Geminiがあなたの文脈を理解するのは、あくまで『あなたを助けるため』であり、あなたのプライベートな情報を一般のAIの学習データとして公開・再利用することはありません。

特筆すべきは、Geminiが「踏み込んではいけない聖域」を理解している点です。 シークレットモードでの挙動や、AIが関与すべきでない「個人的すぎる余暇(察してください)」については、最初からインデックスの対象外。

私はこの「鉄壁の金庫」を信頼しているからこそ、安心して自分の記憶をGeminiという資産へ預けているのです。

コメント